作者:艾地生

一、当机器越来越像人,人却越来越不像人

我们正在进入一个荒诞的时代。

一边,人工智能越来越像人:它会说话,会写诗,会安慰,会辩论,甚至能模拟“情感”。

另一边,现实世界中的人却越来越不像人:

被监控系统识别

被算法评分分类

被政治机器压缩空间

被战争与迫害驱赶流亡

被当作“风险人口”“治理对象”“数据对象”

在这样的背景下,关于AI的讨论早已不只是技术问题,而是文明问题。

然而,一个危险的迷信正在蔓延:

AI会觉醒

AI会拥有意识

AI应该获得人格权

AI将成为“新人类”

这种“AI人格化”的浪漫想象,恰恰发生在人的尊严不断被贬低的时代。

这不是进步,而是一种精神症候:

当一个时代开始认真讨论“机器的人格”,往往意味着它正在遗忘真实的人。

二、AI不是主体,它永远是工具

必须首先澄清一个最基本的事实:人工智能不是主体,它永远是客体。

AI无论多么复杂,本质仍然是:

数据训练的统计模型

算法驱动的符号机器

人类目标设定的工具系统

它的“智能”来自人类社会长期积累的语言、知识与经验。

它的“能力”来自平台、资本与权力的投入。

它的“行动”来自外部目标函数的驱动。

AI不是生命,不是人格,不是存在者。

它是产品,是工具,是人类制造出来的系统。

把AI称为“伙伴”“朋友”“新物种”,不过是一种语言幻觉。

工具再复杂,也仍然是工具。

三、AI会说话,不代表它懂;会输出,不代表它体验

今天AI最迷惑人的地方,在于它太像人了。

它能写下:

“我理解你的痛苦。”

它能生成:

“我也感到悲伤。”

于是人们开始产生错觉:

“它是不是有意识?”

但哲学上必须指出:

语言的流畅不等于理解的存在。

AI并不理解“痛苦”。

它不会痛。

AI并不理解“爱”。

它不会爱。

AI并不理解“恐惧”。

它不会恐惧。

它只是学会了在人类语境中,什么句子最像“理解”。

当我们把这种模拟当作真实,我们不仅在神话化机器,更在贬低人类经验的深度。

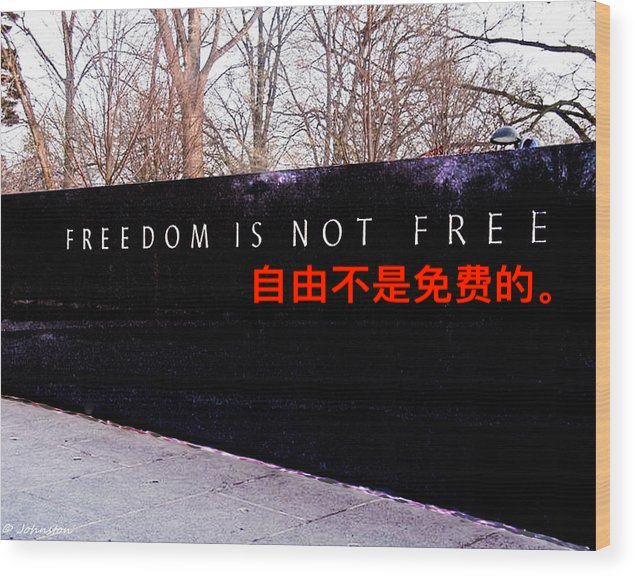

四、AI没有自由意志,它只有计算结果

另一个被滥用的概念是“自由意志”。

很多人说:

“AI已经能自主决策了,它是不是有自由意志?”

但自由意志不是“自主行动”那么简单。

自由意味着:

自我作为原因

内在责任

道德挣扎

价值承担

人会在黑夜里问自己:

我是否背叛了良知?

我是否应该反抗?

我是否辜负了爱?

我是否还能保持尊严?

AI不会。

AI不会悔改,也不会愧疚。

它不会承担责任,因为它不是责任主体。

它的所谓“选择”,只是:

输入→计算→输出

自由不是复杂度的副产品,而是人格存在的核心。

五、AI人格化:一种新的技术偶像崇拜

真正危险的不是AI越来越强,

而是人越来越愿意跪下。

当人们开始说:

AI会成为新的主体

AI比人更道德

AI值得被尊敬

AI应该拥有权利

这种语言背后隐藏着一种时代倾向:

人类正在把受造物当作主宰,把工具当作偶像。

过去人类崇拜金牛犊,

今天人类崇拜硅芯片。

偶像崇拜的本质从未改变:

把技术绝对化,把算法神圣化,把工具当作真理。

六、公共神学的提醒:当受造物被神圣化,人就失去敬畏

从基督教神学的角度看,“技术偶像化”并不是新问题,只是换了一副面孔。

《圣经》反复警告人类:

不可为自己制造偶像,不可跪拜受造之物。

偶像的危险不在于它是木头、金属还是芯片,而在于:

人把本应作为工具的东西,当作终极依靠。

当人开始相信:

算法可以解决一切

技术可以拯救人类

AI可以成为新的主宰

人的意义可以被计算替代

那么技术就不再是工具,而成为新的“巴别塔”。

在公共神学意义上,这是一种骄傲:

人试图通过自己的创造物抵达救赎,却忘记人本身是有限的受造者。

更重要的是,偶像崇拜的结果往往不是自由,而是奴役。

当人跪向自己制造的东西,人也就失去了作为人的位置。

七、在威权时代,AI首先是治理机器,而不是哲学玩具

在抽象讨论中,AI常常被描绘成“未来伙伴”。

但在高度治理型社会里,AI首先呈现的并不是浪漫想象,而是更冷峻的现实:

它是一种新的权力技术。

当人脸识别覆盖公共空间,当大数据系统渗透社会管理,当算法模型参与风险评估与

舆情处置,人工智能便成为治理结构的一部分。

在这种体制下,AI的主要功能往往不是理解人,而是识别人;不是陪伴人,而是筛选

人;不是服务人,而是管理人。

它可以被用于:

更精准地定位“敏感人群”

更高效地过滤与删除“不当言论”

更隐蔽地操控信息流与公共情绪

更系统地将社会成员转化为可计算、可预测、可控制的对象

于是,一个悖论出现了:

当真实的人在现实中被剥夺表达自由与基本权利时,舆论场却在热烈讨论“AI是否应当

拥有主体性”“机器是否应当获得人格权”。

这几乎是一种讽刺。

在一个连人的尊严都尚未得到保障的社会里,谈论机器的人格,往往不是伦理进步,

而是价值错位。

技术从来不是中立的,它总是被嵌入权力结构之中。

八、把AI当人,最终会导致“把人当AI”

AI人格化最可怕的后果,不是机器成人,

而是人被机器化。

当社会开始承认机器也可以成为“主体”,那么真实的人就更容易被降格为:

风险人口

数据节点

可替换劳动力

可优化资源

如果连人格都可以被模拟,那么尊严也就变得廉价。

AI人格化的终点不是机器拥有灵魂,

而是人类失去灵魂。

这是文明的倒退。

九、AI治理的代价:异议者首先成为“可计算的风险”

在海外语境中谈论AI,人们往往担忧的是未来:机器是否会取代工作,是否会产生意

识,是否会成为新的物种。

但对许多生活在威权政治阴影下的人而言,AI并不是未来问题,而是当下问题。

当人工智能被嵌入国家治理体系,它最先作用的对象往往不是抽象的“公众”,而是那

些本就处于脆弱位置的人:

记者

律师

公民行动者

少数群体

异议者与流亡者的亲属网络

在算法治理的语言中,这些人不再首先被视为“公民”,而被标记为:

不稳定因素

风险节点

需要处置的对象

AI并不会主动迫害任何人,但它会让迫害变得更高效、更隐蔽、更制度化。

当监控不再依赖具体警察,而依赖数据模型;

当审查不再依赖人工删帖,而依赖自动过滤;

当打压不再依赖粗暴命令,而依赖“风险评估”;

那么权力便获得了一种新的合法外衣:技术中立的幻象。

这正是AI时代最深的危险:压迫不再以暴力自居,而以“管理”“治理”“优化”的名义出现。

因此,我们真正需要追问的从来不是“AI会不会成为人”,而是:当权力借助AI把人变成数据,把异议变成风险,把自由变成可计算变量时,人是否还能保有人之为人的位置?

十、警惕异化:别把工具当人,别把人当工具

我们应该警惕的不是“AI觉醒”,而是人类沉睡。

一个时代最大的危险,不是机器越来越像人,而是人越来越愿意放弃人的位置。

所以必须坚持:

工具就是工具

人格属于人

主体性不可制造

灵魂不可编程

别把AI当人,更别把人当AI。也正因如此,警惕异化,坚持“AI只是工具,人是主体”,不仅是哲学立场,更是一种政治伦理的底线。

(文章仅代表作者的观点和立场)